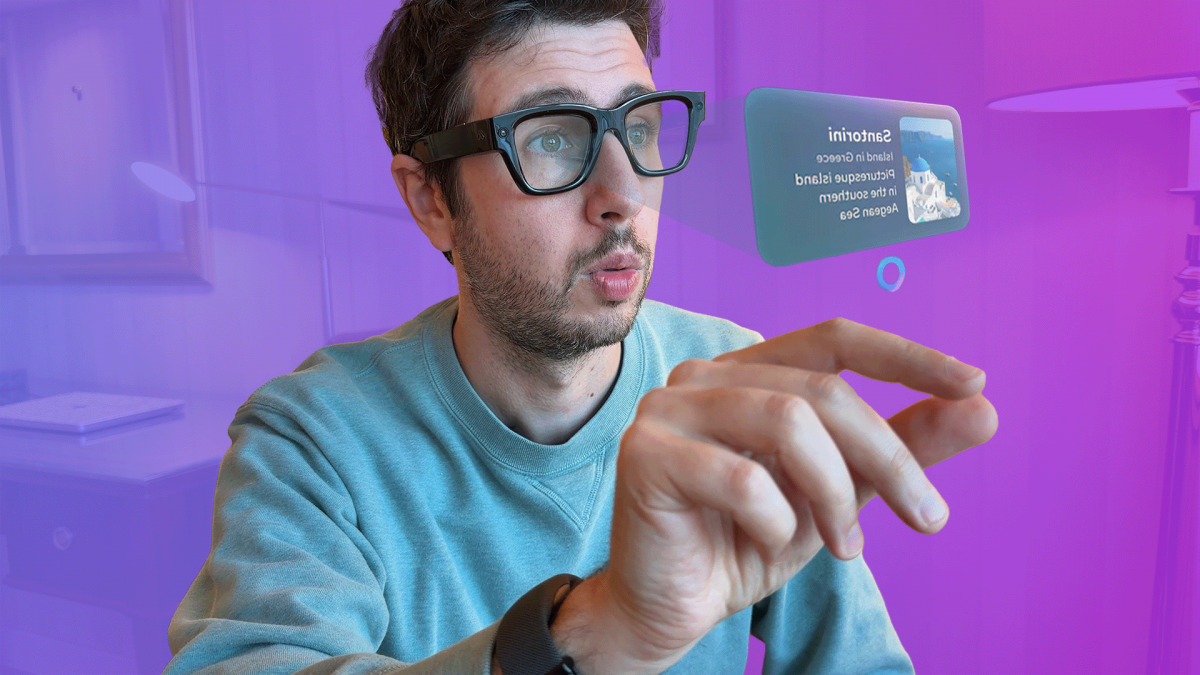

Meta Ray-Ban Display: aggiornamento con nuove funzioni e SDK

Sono passati circa sei mesi dal lancio dei Meta Ray-Ban Display, gli occhiali smart con display integrato che Meta considera il suo prodotto più avanzato in assoluto. Il bilancio, almeno secondo Meta stessa, è positivo: gli ordini vengono evasi, i negozi sono riforniti e soprattutto il software continua ad aggiornarsi a ritmo sostenuto. Ed è proprio su questo segmento che arrivano le novità più interessanti.

Vuoi ascoltare il riassunto dell’articolo?

Cosa cambia con l’aggiornamento di oggi

Le nuove funzioni in rollout sono quattro, e alcune erano attese da tempo:

- Scrittura neurale (Neural Handwriting) ora disponibile per tutti, non solo per alcuni utenti selezionati. Funziona su Instagram, WhatsApp, Messenger e sulle app di messaggistica native di Android e iOS.

- Display Recording: registra in un unico video quello che vedi attraverso le lenti, le interazioni con il display e l’audio. Il risultato è un file pronto da condividere.

- Indicazioni stradali estese a tutta la rete stradale USA e, novità importante, disponibili anche per alcune città internazionali tra cui Londra, Parigi e Roma.

- Didascalie live (Live Captions): trascrivono in tempo reale le parole che qualcuno ti dice di persona o durante una chiamata. Arrivano su WhatsApp, Facebook Messenger e Instagram Direct.

Oltre a queste quattro, nei mesi precedenti erano già arrivati widget aggiuntivi sulla schermata principale (Promemoria, Meteo, Azioni, Calendario), un accesso rapido alle playlist Spotify e i Reel di Instagram.

In estate arriverà anche Muse Spark, il nuovo modello AI di Meta pensato specificamente per i suoi dispositivi indossabili.

Aperto agli sviluppatori: Web App e toolkit per gli occhiali

La novità che potrebbe avere l’impatto più duraturo è l’apertura di un accesso developer per i Ray-Ban Display. Meta ha lanciato un programma di anteprima che permette agli sviluppatori di creare esperienze dedicate agli occhiali in due modi distinti.

Il primo sono le Web App: si scrivono in HTML, CSS e JavaScript e si distribuiscono via URL direttamente sugli occhiali. Il secondo è il Wearables Device Access Toolkit, che consente di estendere app mobile esistenti sul display degli occhiali aggiungendo testo, immagini, liste, pulsanti e video. Meta specifica che non serve esperienza di programmazione tradizionale: basta usare uno degli strumenti AI per il codice già disponibili sul mercato.

È una mossa che ricorda da vicino l’apertura degli store sulle prime piattaforme mobile: il valore degli occhiali dipenderà molto da quello che terze parti ci costruiranno sopra, e Meta lo sa bene.

Resta da vedere se l’ecosistema risponderà, ma almeno la porta è aperta.

Per chi segue l’evoluzione degli occhiali smart come categoria, questo aggiornamento conferma che Meta è al momento l’unico grosso player con un prodotto maturo ed in crescita attiva.

Source link