Perché un nuova generazione di console adesso non serve assolutamente a niente

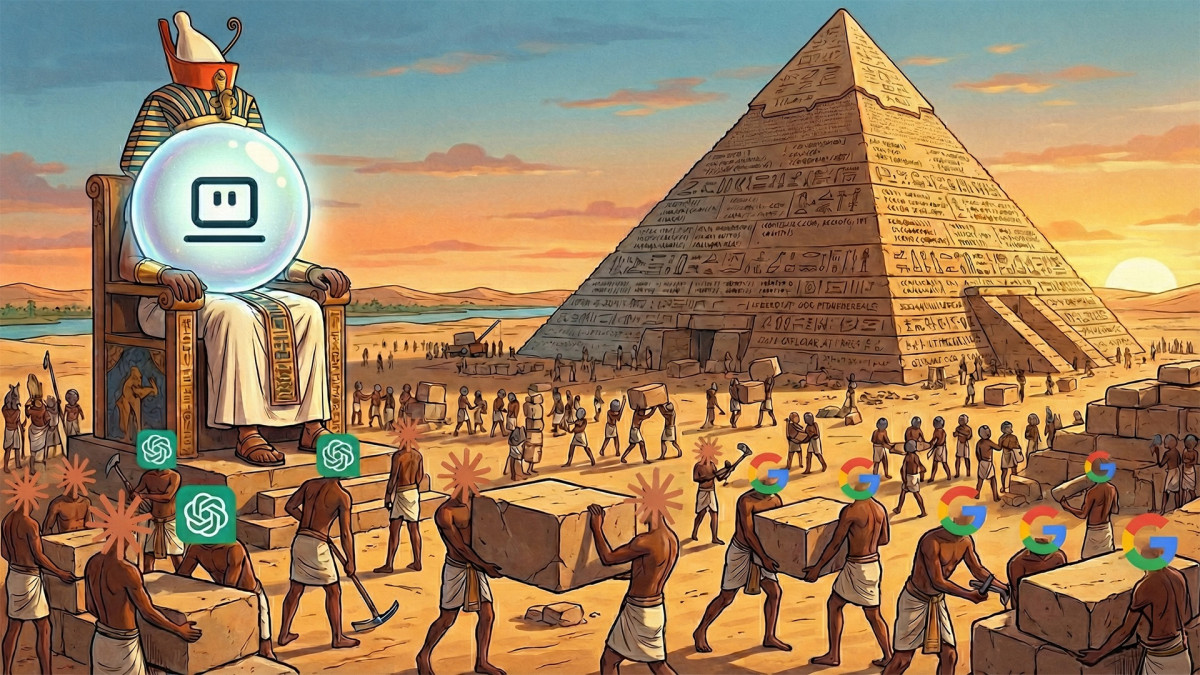

La chiusura di uno studio così ben voluto dal pubblico come Bluepoint è la cartina tornasole di tutto quello che non sta funzionando nell’industria videoludica, un declino, per certi versi inaspettato, iniziato secondo noi, poco dopo il lancio delle nuove console. Ed ora vi spieghiamo perché.

1 – Perché oggi non serve una nuova console più potente

Il cambio di generazione tra PS4 e PS5 ha portato con sé una potenza enorme. Siamo passati da meno di 2 a 12 Tflop nel caso di Xbox Series X. Le CPU sono diventate finalmente moderne, abbiamo SSD capaci di azzerare i caricamenti, GPU con ray tracing integrati ed in generale una capacità di calcolo nettamente superiore. Dal punto di vista hardware, l’attuale generazione di console non è un vero limite. Il problema è che la potenza in più, in questo cambio di generazione non si è tradotta automaticamente in progresso grafico percepibile in modo netto.

Questo perché per la prima volta gli sviluppatori non sono stati in grado davvero di sfruttare questa nuova potenza. Per farlo infatti servono investimenti massicci, soprattutto umani.

Una GPU più potente non crea da sola texture migliori, animazioni più sofisticate, personaggi più credibili. Servono artisti altamente specializzati, technical artist capaci di gestire pipeline complesse, animatori esperti in performance capture avanzata, programmatori di engine in grado di ottimizzare sistemi sempre più articolati e lontani dallo sviluppare nuovi bug.

Ogni salto di potenza comporta un salto proporzionale nella complessità produttiva: un personaggio con shader fisicamente accurati, capelli simulati e animazioni facciali credibili richiede molte più ore di lavoro rispetto a dieci anni fa. Un open world con illuminazione dinamica coerente richiede tool evoluti, asset molto più complessi, e team sempre più grandi per crearli e gestirli. Il risultato? Un aumento drastico dei costi e tempi di sviluppo sempre più dilatati.

I budget AAA hanno superato facilmente i 150 o 200 milioni di dollari, marketing escluso. I tempi di sviluppo si sono allungati fino a cinque o sei, addirittura sette anni. Ogni progetto è diventato una scommessa industriale enorme: basta un gioco andato male per chiudere uno studio, per sempre.

Introdurre a stretto giro una nuova generazione di console significherebbe alzare ulteriormente l’asticella tecnica, chiedendo agli studi un nuovo salto organizzativo quando stanno ancora cercando di assorbire quello precedente, e non hanno ancora risolto i problemi arrivati con PS5 ed Xbos Series X, figuriamoci le GPU della serie 40 e 50 di Nvidia. Il limite attuale non è la potenza delle console. È la capacità del ciclo produttivo di sfruttarla in modo sostenibile, ed ecco perché non siamo pronti, o meglio, non è pronta l’industria, ad una nuova generazione di console.

2 – Perché la “nuova generazione” non ha realmente superato la precedente

Se guardiamo ai risultati concreti, PS5 non ha prodotto un salto percepito paragonabile a quello visto tra PS2 e PS3 o tra PS3 e PS4. I migliori titoli di fine ciclo PS4 avevano già raggiunto una maturità visiva altissima. Certo, oggi gli stessi giochi in versione PS5, sono più fluidi, più definiti, più stabili. Ma non più complessi. Ed ecco perché siamo stati invasi da remake e remastered. Anche nel caso di giochi completamente nuovi il miglioramento è rimasto confinato soprattuto nelle performanca: 60FPS, una risoluzione nativa più alta, e nella migliore delle ipotesi, qualche effetto in ray tracing. Ma la complessità globale è rimasta più o meno la stessa.

Questo spiega anche il motivo per cui, per contenere i costi, molti studi hanno adottato Unreal Engine come motore di riferimento. Unreal è uno strumento potentissimo, che consente di ottenere risultati grafici di alto livello senza sostenere i costi di un engine proprietario. Questo ha favorito l’emergere di studi cinesi e coreani capaci di produrre titoli visivamente impressionanti con strutture di sviluppo immense, che gli sviluppatori asiatici hanno dimostrato di saper gestire, a differenza di quelli occidentali.

L’adozione massiccia dello stesso motore comporta anche un rischio di omologazione. Il perimetro delle capacità di Unreal è amplissimo, ma non illimitato. Ad esempio ambiti come la distruttibilità ambientale avanzata richiedono investimenti aggiuntivi e un lavoro custom. Non sorprende che molti titoli recenti risultino statici, con ambienti meno reattivi di quanto si fosse visto anche dieci anni fa in produzioni come Quantum Break. È un paradosso evidente: abbiamo forse mondi più dettagliati ma sicuramente meno dinamici.

E l’intelligenza artificiale generativa? Per ora sembra aver inciso solo marginalmente sul cuore dello sviluppo AAA. Può accelerare la prototipazione e la creazione di asset preliminari, ma integrare, ottimizzare e armonizzare resta un lavoro umano altamente specializzato. Inoltre esiste un altro aspetto che le aziende non possono ignorare: la percezione del pubblico.

Una parte consistente dell’utenza non vede di buon occhio asset e contenuti generati dall’IA, percepiti come artificiali e per questo, di qualità inferiore. A ciò si aggiunge una questione etica legata al rispetto del lavoro. Non a caso, alcune aziende hanno iniziato a dichiarare pubblicamente di non voler utilizzare IA generative nei propri processi creativi, trasformando questa scelta in un elemento di comunicazione positiva.

Si aprono poi ulteriore interrogativi: se intere fasi della creazione vengono delegati sistematicamente all’IA, cosa succede alle competenze umane nel medio periodo? Se tutti chiedono ad un algoritmo di generare texture, quanti professionisti sapranno ancora costruirle con la stessa consapevolezza tecnica? Se tutti programmano il codice con l’IA chi saprà davvero correggerlo in caso di errori complessi? Siamo in una fase dell’informatica in cui la dispersione del know-how è, per la prima volta, un rischio concreto.

3 – Perché il caso Bluepoint è emblematico

In questo quadro si inserisce il caso Bluepoint. Uno studio amato dal pubblico, capace di firmare remake di altissimo livello tecnico. Ma con costi di sviluppo sempre più alti, Sony – come altri publisher – ha dovuto ripensare le proprie strategie. I “game as a service” promettono qualcosa di diverso: ricavi ricorrenti e monetizzazione nel tempo. Se funzionano, possono sostenere un’intera divisione per anni.

Da quello che sappiamo Bluepoint sarebbe stata messa al lavoro su un live service legato a God of War, un progetto potenzialmente ad altissimo ritorno economico. Ma il mercato PlayStation è storicamente legato alle grandi esperienze narrative single player ed il progetto non ha soddisfatto le aspettative interne, per motivi che probabilmente non conosceremo mai del tutto. Qui emerge un altro nodo centrale della questione: uno studio di sviluppo non è un’entità monolitica. È fatto di persone. Direttori creativi, programmatori engine, artisti, designer. Nelle grandi aziende esiste una naturale fluidità, soprattutto nei momenti critici tra la fine di un progetto e l’inizio di un altro, ma un gioco di successo trattiene gran parte del suo team, mentre un fallimento vede perdere i pezzi già durante lo sviluppo.

Il caso Bluepoint non è isolato. Basta guardare a quanto accaduto con Arkane per capire quanto sia fragile l’equilibrio su cui si reggono oggi gli studi di sviluppo. Arkane per anni è stata sinonimo di immersive sim di altissimo livello: Dishonored, Prey, Deathloop. Giochi autoriali, finemente cesellati, a loro modo ancora oggi unici. Eppure, tra quei progetti e Redfall, qualcosa si è rotto.

Nel tempo lo studio ha perso figure chiave come Raphaël Colantonio, fondatore e mente creativa storica, Ricardo Bare, lead designer su Prey e Dishonored 2, Julien Roby, executive producer di lungo corso, e Dana Nightingale, design director coinvolta nei progetti più importanti. Redfall non è stato solo un gioco tecnicamente problematico.

È stato percepito come un tradimento dell’identità che aveva reso grande Arkane. Un prodotto fuori fuoco, inserito in un mercato saturo e competitivo. Un progetto sbagliato, in un contesto di costi elevatissimi e aspettative esagerate, può incrinare la stabilità di un team. Perché quando un gioco costato centinaia di milioni fallisce, lo studio chiude senza se e senza ma.

Una nuova generazione di console non risolverebbe nulla

Negli anni sviluppatori e giocatori hanno sognato hardware sempre più potenti perché rappresentavano la strada per ottenere giochi sempre più sconvolgenti graficamente, il vero driver dell’industria. Il gameplay, duole dirlo, spesso arriva un passo dopo nei motivi che spingono l’hype e poi il successo di un titolo. Quando però la potenza è diventata molto più che sufficiente, questo ciclo si è spezzato. I progetti troppo grandi sono quasi impossibili da portare avanti senza incappare in una miriade di problemi. Gli studi di sviluppo non sembrano aver trovato la quadra per superare davvero i risultati raggiunti nella vecchia generazione.

La potenza è aumentata, ma i processi di sviluppo non sono in grado di sfruttarla fino in fondo. L’organizzazione del lavoro, la divisione dei compiti, la gestione delle competenze in progetti così enormi non riescono a far evolvere il medium come ci si aspetterebbe.

La complessità è tale che nessuno per ora è riuscito a risolverla: né spendendo centinaia di milioni, né creando team giganteschi che, inevitabilmente, portano con sé nuovi freni allo sviluppo. Un team di 200 persone probabilmente è più efficace e reattivo di uno con 1000 addetti, probabilmente impossibile da gestire. C’è un solo gioco all’orizzonte che sembra voler scardinare questo teorema, seppur porti con se tempi di sviluppo e costi inimmaginabili per qualsiasi altro prodotto: GTA 6. E se anche Rockstar riuscirà nell’impresa, sarà l’eccezione, e non la regola.

Source link